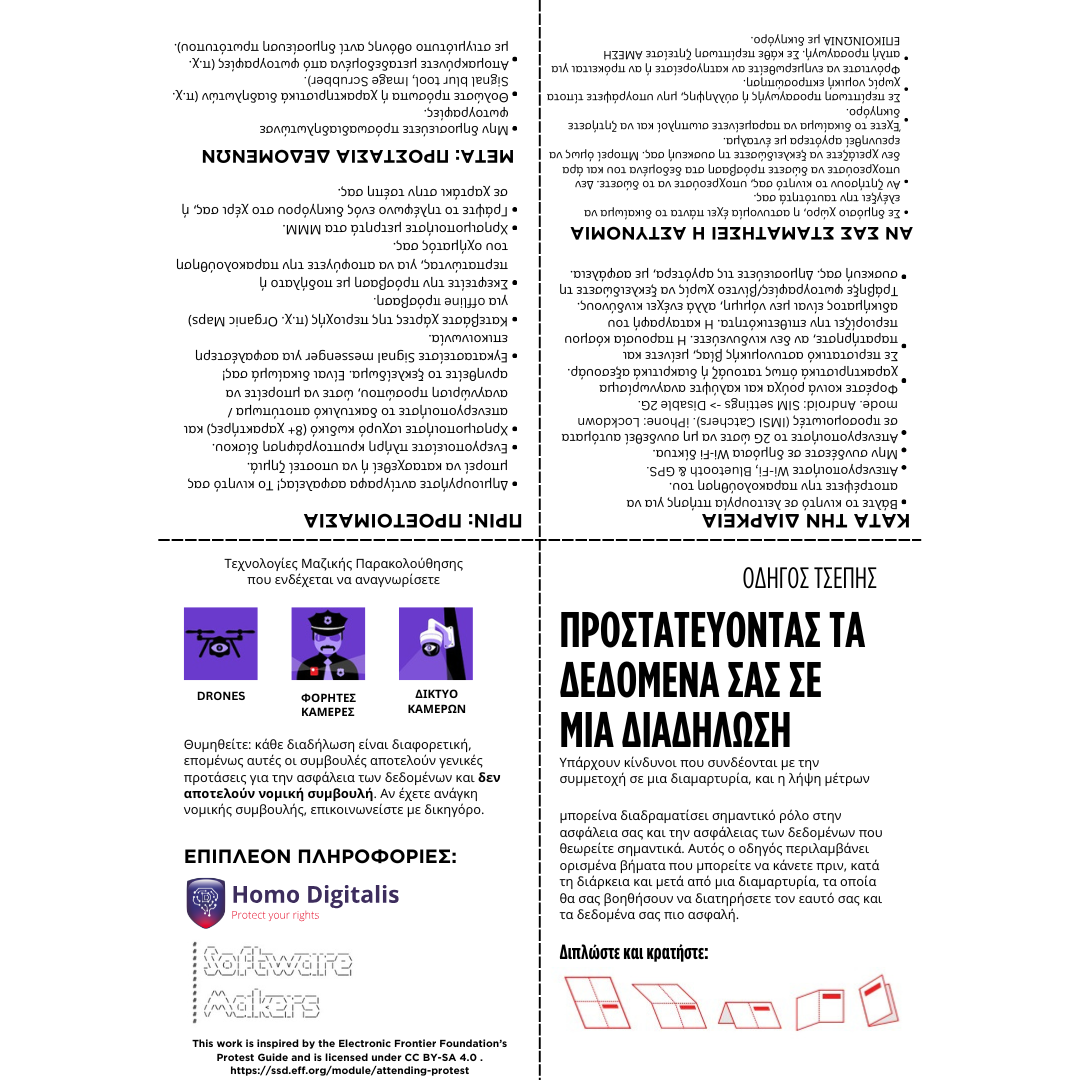

Διάβασε τον Οδηγό Τσέπης για προστασία της ιδιωτικότητάς σου σε πορείες

Δύο χρόνια συμπληρώνονται σήμερα, Παρασκευή 28 Φεβρουαρίου, από την τραγωδία των Τεμπών, με απεργίες και στάσεις εργασίας να έχουν προγραμματιστεί σε όλη την χώρα και στο εξωτερικό τόσο για να τιμηθεί η μνήμη των 57 θυμάτων του σιδηροδρομικού δυστυχήματος όσο και για να αποδοθεί δικαιοσύνη και να τιμωρηθούν οι υπεύθυνοι.

Τι συμβαίνει όμως με τις συσκευές σου και τα προσωπικά δεδομένα σου και πως μπορείς να πάρεις μέτρα για να διασφαλίσεις την προστασία τους σε μία πορεία διαμαρτυρίας;

Η Homo Digitalis από κοινού με τη Software Makers, ΑΜΚΕ με έδρα το Ηράκλειο της Κρήτης, μετέφρασαν και προσάρμοσαν το σύντομο οδηγό τσέπης του Electronic Frontier Foundation (EFF) στα ελληνικά δεδομένα παρέχοντας ορισμένα βήματα που μπορείτε να κάνετε πριν, κατά τη διάρκεια και μετά από μια διαμαρτυρία, τα οποία θα σας βοηθήσουν να διατηρήσετε τον εαυτό σας και τα δεδομένα σας πιο ασφαλή.

Δείχνουμε την αλληλεγγύη μας και τη αμέριστη συμπαράστασή μας!

Το κείμενο του οδηγού βρίσκεται διαθέσιμο προς εκτύπωση εδώ.

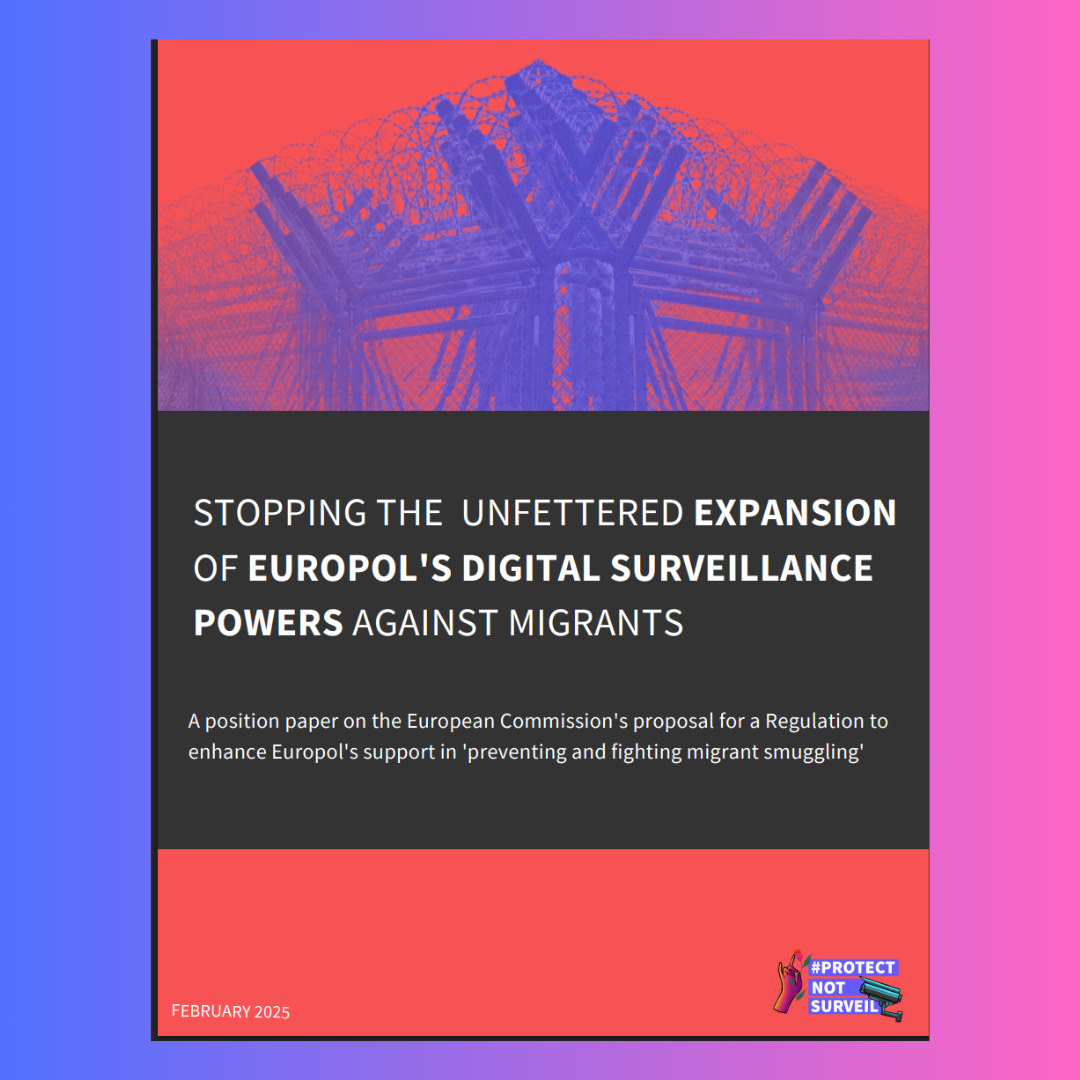

Ο συνασπισμός Protect Not Surveil δημοσιεύει την έκθεσή του για τον Κανονισμό της Europol

Σήμερα, 20 Φεβρουαρίου ο συνασπισμός #ProtectNotSurveil, στον οποίο συμμετέχει και η Homo Digitalis, δημοσιεύει την έκθεσή του για τον Κανονισμό της Europol και καλεί σε πλήρη απόρριψη της πρότασης της Ευρωπαϊκής Επιτροπής.

Ο Κανονισμός της Europol, ακούσια, στηρίζει το επιχειρηματικό μοντέλο των διακινητών, ενώ ταυτόχρονα ποινικοποιεί τη μετανάστευση.

Κρίσιμα σημεία του Κανονισμού της Europol:

• Επεκτείνει τις δυνατότητες επιτήρησης της Europol πέραν της εντολής της, υπό το πρόσχημα της καταπολέμησης της «διακίνησης μεταναστών», δίνοντας στην Europol νέες εξουσίες «σχετικά με όλα τα εγκλήματα για τα οποία είναι αρμόδια».

• Ο Ευρωπαίος Επόπτης Προστασίας Δεδομένων (EDPS) έχει ήδη εκφράσει ανησυχίες ότι η νομοθετική πρωτοβουλία ενέχει σημαντικούς κινδύνους για τα δικαιώματα προστασίας δεδομένων και ιδιωτικότητας των μεταναστών, επιτρέποντας τη μαζική συλλογή και ανταλλαγή δεδομένων μεταξύ των κρατών μελών και των ευρωπαϊκών οργανισμών (όπως η Frontex), γνωστών για παραβιάσεις ανθρωπίνων δικαιωμάτων, καθώς και με τρίτες χώρες χωρίς νομική βάση για ανταλλαγή δεδομένων με την ΕΕ.

• Η πρόταση είναι ανασφαλής και ατεκμηρίωτη, παρουσιάζεται χωρίς επαρκή εκτίμηση επιπτώσεων και βασίζεται σε ψευδείς ισχυρισμούς ότι οι διακινητές αποτελούν τη μεγαλύτερη απειλή για την ασφάλεια των μεταναστών (έκθεση του ΟΗΕ).

• Εκατομμύρια ευρώ από δημόσιους πόρους της ΕΕ θα σπαταληθούν για τις νέες δραστηριότητες της Europol, σε μια ψευδή λύση για τη διαχείριση της μετανάστευσης που απλώς δεν πρόκειται να λειτουργήσει.

Μια σύνοψη της θέσης μας δημοσιεύθηκε και στο EUobserver. Ολόκληρη η έκθεση είναι διαθέσιμη εδώ.

Απολογιστικό Δελτίο Τύπου ΔΗΜΟΚΡΑΤΙΑ ΧΩΡΙΣ ΟΞΥΓΟΝΟ Η κατάσταση του Κράτους Δικαίου στην Ελλάδα σήμερα

Την Τρίτη, 4 Φεβρουαρίου, στον Δικηγορικό Σύλλογο Αθηνών πραγματοποιήθηκε με επιτυχία και σημαντική προσέλευση η Συνέντευξη Τύπου για τη σημερινή κατάσταση του Κράτους Δικαίου στην Ελλάδα από τις ανεξάρτητες οργανώσεις Ελληνικό Συμβούλιο για τους Πρόσφυγες (ΕΣΠ), Ελληνική Ένωση για τα Δικαιώματα του Ανθρώπου (ΕλΕΔΑ), HIAS Ελλάδος, Homo Digitalis, Υποστήριξη Προσφύγων στο Αιγαίο (RSA), Reporters United, Solomon και Vouliwatch.

Μπορείτε να παρακολουθήσετε τη Συνέντευξη Τύπου εδώ.

Ευχαριστούμε θερμά το omniatv για την οργάνωση και διαδικτυακή φιλοξενία της ΣΤ.

Κατά την εκδήλωση, την οποία συντόνισε η δημοσιογράφος Νατάσα Γιάμαλη, εκπρόσωποι των συνεργαζόμενων Οργανώσεων παρουσίασαν τα βασικά σημεία της κοινής αναφοράς που υποβάλαμε για 3η χρονιά στην Ευρωπαϊκή Επιτροπή για το Κράτος Δικαίου στην Ελλάδα το 2024, στο πλαίσιο του ετήσιου ελέγχου των εθνικών συστημάτων που πραγματοποιεί η Κομισιόν.

Υπογραμμίσαμε τα βασικά προβλήματα που υπονομεύουν συστηματικά το Κράτος Δικαίου στην Ελλάδα και, σε συνδυασμό με την αυταρχικοποίηση της πολιτικής και τις επιθέσεις στα ανθρώπινα δικαιώματα, απλώνουν ένα σκοτεινό πέπλο απειλών στη Δημοκρατία.

Παράλληλα, τονίσαμε το επείγον του αιτήματός μας προς την ΕυρωπαΪκή Επιτροπή για την αλλαγή της προσέγγισής της και την ανάγκη να δώσει έμφαση όχι στις «δεσμεύσεις» ή «προθέσεις» του κράτους, αλλά στη ρεαλιστική αποτύπωση της κατάστασης στη χώρα. Στο πλαίσιο αυτό, οι συστηματικές παραβιάσεις θεμελιωδών αρχών του Κράτους Δικαίου δεν μπορούν να εκλαμβάνονται ως μεμονωμένα περιστατικά.

Μας καλωσόρισε στον Δικηγορικό Σύλλογο Αθηνών, ο Σύμβουλος, τ. αντιπρόεδρος του ΔΣΑ, Αλέξανδρος Μαντζούτσος απευθύνοντας έναν σύντομο χαιρετισμό.

Στην παρουσίαση της κοινής αναφοράς, ο Στέφανος Λουκόπουλος, Διευθυντής Vouliwatch δήλωσε εμφατικά:

«Όταν το ίδιο το Κράτος υποβαθμίζει αρχές, διαδικασίες και θεσμικά αντίβαρα λειτουργώντας με αυταρχισμό, ατιμωρησία και νομική ασυνέπεια, ενισχύει την απαξίωση των θεσμών στα μάτια των πολιτών και οδηγεί, με μαθηματική ακρίβεια, στην αυταρχικοποίηση της κοινωνίας, με ανυπολόγιστες συνέπειες για το μέλλον της Δημοκρατίας.»

Στη συνέχεια τον λόγο πήρε ο Μίνως Μουζουράκης, δικηγόρος στην Υποστήριξη Προσφύγων στο Αιγαίο (RSA) τονίζοντας ότι:

«Υπάρχει ένα στοιχείο που συνδέει τα Τέμπη με το ναυάγιο της Πύλου, τις υποκλοπές σε βάρος πολιτικών και δημοσιογράφων, τη βίαιη εξαφάνιση προσφύγων από τον Έβρο και το Αιγαίο, την αστυνομική βία: Η αδυναμία της Ελληνικής Δικαιοσύνης να εκπληρώσει το καθήκον της και να αποδώσει ευθύνες για αυθαιρεσίες και ποινικά αδικήματα που διαπράττει το κράτος.»

Ακολούθησαν σύντομες εισηγήσεις – παρεμβάσεις από εκπροσώπους των υπόλοιπων οργανώσεων, οι οποίες συνόψισαν τις βασικές προβληματικές ανά θεματική:

Αλέξανδρος Κωνσταντίνου | Δικηγόρος, Ελληνικό Συμβούλιο για του Πρόσφυγες – GCR

«Πρόσφατα το Ευρωπαϊκό Δικαστήριο Δικαιωμάτων του Ανθρώπου διαπίστωσε για πρώτη φορά την αναποτελεσματικότητα της ελληνικής ποινικής δικαιοσύνης να διερευνήσει υποθέσεις επαναπροώθησεων (A.R.E. κατά Ελλάδας, Απόφαση της 7ης Ιανουαρίου 2025), δηλαδή υποθέσεις που αφορούν την παράνομη δράση κρατικών οργάνων και υπό αυτήν την έννοια αφορούν τον πυρήνα του Κράτους Δικαίου. Η διαπίστωση αυτή του Δικαστηρίου έρχεται σε μια στιγμή που τα ζητήματα της διερεύνησης, λογοδοσίας και απόδοσης ευθυνών βρίσκονται στο επίκεντρο της δημόσιας συζήτησης, και θα πρέπει να προβληματίσει σοβαρά όλα τα αρμόδια όργανα της ελληνικής Πολιτείας, συμπεριλαμβανομένης της ελληνικής Δικαιοσύνης».

Έλλη Κριωνά-Σαράντη |Δικηγόρος, HIAS Ελλάδος

«Εξακολουθεί το φαινόμενο της καταχρηστικής ποινικοποίησης μεταναστών, υπερασπιστών ανθρωπίνων δικαιωμάτων και δικηγόρων ως διακινητών, παρά τις συνεχείς ενστάσεις εθνικών, διεθνών και ευρωπαϊκών θεσμών ανθρωπίνων δικαιωμάτων».

Θοδωρής Χονδρόγιαννος | Δημοσιογράφος, Reporters United

«Η υπόθεση των υποκλοπών αναδεικνύει τις παθογένειες του Κράτους Δικαίου με φόντο τις συστηματικές παραβιάσεις του συνταγματικά κατοχυρωμένου απορρήτου των επικοινωνιών: οι κυβερνητικές επιθέσεις κατά του προέδρου της ΑΔΑΕ, η δικαστική παρενόχληση μελών της, η παραβίαση της αυξημένης πλειοψηφίας της Διάσκεψης των Προέδρων της Βουλής (⅗) για την αντικατάσταση μελών της ΑΔΑΕ και την αποσόβηση επιβολής κύρωσης σε βάρος της ΕΥΠ, η ματαίωση διερεύνησης του κοινού κέντρου ΕΥΠ – Predator και η «νομιμοποίηση» παρακολουθήσεων κατά υπουργών, πολιτικών, δημοσιογράφων και Ενόπλων Δυνάμεων, η παραβίαση της υποχρέωσης της ΕΥΠ να ενημερώνει πάραυτα την ΑΔΑΕ και οι αγωγές κατά δημοσιογράφων».

Δανάη Μαραγκουδάκη | Δημοσιογράφος, Solomon

«Η υπερσυγκέντρωση μεγάλων μέσων ενημέρωσης σε λίγους και ισχυρούς επιχειρηματίες, η αλληλεξάρτηση των ΜΜΕ, του κράτους και των τραπεζών και η αδυναμία των εποπτικών Αρχών να εξασφαλίσουν το απαιτούμενο επίπεδο διαφάνειας δημιουργούν ένα ασφυκτικό πλαίσιο λειτουργίας που υποβαθμίζει όχι μόνο την πολυφωνία αλλά συνολικά τη δημοκρατία στη χώρα.»

Κατερίνα Πουρναρά | Δικηγόρος, Αντιπρόεδρος της Ελληνικής Ένωσης για τα Δικαιώματα του Ανθρώπου

«Σε μια περίοδο όπου η εμπιστοσύνη στους δημοκρατικούς θεσμούς κλονίζεται από υποθέσεις όπως τα Τέμπη και το Ναυάγιο της Πύλου, η ανεξέλεγκτη και παράνομη αστυνομική βία δεν απειλεί μόνο τις ατομικές ελευθερίες, αλλά υπονομεύει τη δημοκρατία, ενισχύοντας την αυταρχικοποίηση των κρατικών θεσμών».

Λαμπρινή Γυφτοκώστα | Διευθύντρια σε θέματα Δικαιωμάτων του Ανθρώπου & Τεχνητής Νοημοσύνης, Homo Digitalis

«Η προστασία των προσωπικών δεδομένων αποτελεί θεμελιώδες δικαίωμα και κρίσιμο ζήτημα για τη δημοκρατία και τη διαφάνεια στη χώρα μας. Οι αποφάσεις της Αρχής Προστασίας Δεδομένων Προσωπικού Χαρακτήρα (ΑΠΔΠΧ) με την επιβολή προστίμων συνολικού ύψους 775.000 ευρώ σε τρία Υπουργεία μόνο το 2024 επιβεβαιώνουν την μη συμμόρφωση κρατικών φορέων με την ισχύουσα νομοθεσία, υπονομεύοντας το κράτος δικαίου και ενισχύοντας την έλλειψη εμπιστοσύνης των πολιτών προς τους θεσμούς».

| ΔΕΙΤΕ ΤΗΝ ΠΕΡΙΛΗΨΗ της ΑΝΑΦΟΡΑΣ ΕΔΩ (στα ελληνικά) |

| ΒΡΕΙΤΕ ΤΗΝ ΠΛΗΡΗ ΑΝΑΦΟΡΑ ΕΔΩ (στα αγγλικά) |

Πρόσκληση σε Συνέντευξη Τύπου: ΔΗΜΟΚΡΑΤΙΑ ΧΩΡΙΣ ΟΞΥΓΟΝΟ Η κατάσταση του Κράτους Δικαίου στην Ελλάδα σήμερα

Παράνομα pushbacks, αστυνομική βία, ναυάγιο της Πύλου, σκάνδαλο των υποκλοπών, δυστύχημα των Τεμπών, απουσία λογοδοσίας και απόδοσης δικαιοσύνης, κακή νομοθέτηση, «πολυνομοσχέδια», διαρκείς τροποποιήσεις νόμων και άσχετες τροπολογίες, συρρίκνωση της ελευθερίας του τύπου, επιθέσεις και αγωγές κατά δημοσιογράφων, συγκέντρωση της ιδιοκτησίας των ΜΜΕ, παραβιάσεις προσωπικών δεδομένων από τις αρχές, διαφθορά, αδιαφάνεια στα δώρα σε πολιτικά πρόσωπα και στους συνεργάτες των Υπουργών…

Αυτά είναι ορισμένα μόνο από τα βασικά προβλήματα του Κράτους Δικαίου στην Ελλάδα σήμερα. Σήμερα που η αυταρχικοποίηση της πολιτικής, η επανεκλογή του Ντόναλντ Τραμπ και η άνοδος της ακροδεξιάς, η αυξανόμενη διεύρυνση των κοινωνικών ανισοτήτων, η επικράτηση του λαϊκισμού στον δημόσιο λόγο και οι επιθέσεις στα ανθρώπινα δικαιώματα απλώνουν ένα σκοτεινό πέπλο απειλών στη Δημοκρατία.

Στο πλαίσιο αυτών των εξελίξεων και ενόψει της συνεχιζόμενης υποχώρησης των θεσμών στη χώρα μας, η ελληνική Κοινωνία των Πολιτών μάχεται με άμεση προτεραιότητα την προάσπιση του Κράτους Δικαίου και την ενίσχυση της διαφάνειας και της λογοδοσίας.

Οι ανεξάρτητες οργανώσεις Ελληνικό Συμβούλιο για τους Πρόσφυγες (ΕΣΠ), Ελληνική Ένωση για τα Δικαιώματα του Ανθρώπου (ΕλΕΔΑ), HIAS Ελλάδος, Homo Digitalis, Υποστήριξη Προσφύγων στο Αιγαίο (RSA), Reporters United, Solomon και Vouliwatch καταθέσαμε για 3η χρονιά κοινή έκθεση στην Ευρωπαϊκή Επιτροπή για το Κράτος Δικαίου στην Ελλάδα το 2024, στο πλαίσιο του ετήσιου ελέγχου των εθνικών συστημάτων.

Απαιτούμε ξεκάθαρα την αλλαγή της προσέγγισης της Κομισιόν, με έμφαση όχι στις «δεσμεύσεις» ή «προθέσεις» του κράτους, αλλά στη ρεαλιστική αποτύπωση της κατάστασης στη χώρα. Στο πλαίσιο αυτό, οι συστηματικές παραβιάσεις θεμελιωδών αρχών του Κράτους Δικαίου δεν μπορούν να εκλαμβάνονται ως μεμονωμένα περιστατικά.

Σας προσκαλούμε στη Συνέντευξη Τύπου, που θα πραγματοποιηθεί την Τρίτη 4 Φεβρουαρίου, στις 11.00 το πρωί, στον Δικηγορικό Σύλλογο Αθηνών. Κατά τη διάρκεια της εκδήλωσης, θα παρουσιάσουμε αυτήν τη συνεισφορά και θα δημοσιοποιήσουμε την έκθεση που καταθέσαμε στην Ευρωπαϊκή Επιτροπή.

ΟΜΙΛΗΤ(ΡΙ)ΕΣ

Χαιρετισμό θα απευθύνει ο Σύμβουλος, τ. Αντιπρόεδρος ΔΣΑ, Αλέξανδρος Μαντζούτσος.

Την αναφορά θα παρουσιάσουν οι:

Στέφανος Λουκόπουλος | Vouliwatch

Μίνως Μουζουράκης | RSA

Σύντομες παρεμβάσεις:

Λαμπρινή Γυφτοκώστα | Homo Digitalis

Έλλη Κριωνά-Σαράντη | HIAS

Αλέξανδρος Κωνσταντίνου | GCR

Δανάη Μαραγκουδάκη | Solomon

Κατερίνα Πουρναρά | ΕλΕΔΑ

Θοδωρής Χονδρόγιαννος | Reporters United

Συντονίζει η δημοσιογράφος Νατάσα Γιάμαλη (MEGA TV).

Τρίτη 4 Φεβρουαρίου | 11.00 -13.00 | ΔΣΑ (Ακαδημίας 60, Αθήνα)

Η Συνέντευξη Τύπου θα διεξαχθεί στα ελληνικά.

Συνεχίζουμε τη συμμετοχή μας στο πρόγραμμα Accelarator του ΗΙGGS

H ομάδα της AMKE Homo Digitalis συμμετέχει στο πρόγραμμα Accelerator του HIGGS ήδη από τον Οκτώβριο του 2024 και τώρα ξεκινάει ο δεύτερος κύκλος εντατικών σεμιναρίων με σκοπό την εκπαίδευση μας για τη βελτίωση των οργανωτικών δομών μας αλλά και της διαχείρισης των εργασιών μας.

Συγκεκριμένα, το πρόγραμμα Accelerator μας βοηθάει να μάθουμε, να βελτιωθούμε και να διαμορφώσουμε μία καλύτερη στρατηγική για το μέλλον μας. Η δυνατότητα συμμετοχής μας στο πρόγραμμα αυτό μας δίνει πρόσβαση σε υψηλού επιπέδου πληροφορίες που θα μας βοηθήσουν να βελτιώσουμε τη διοίκηση και τη δράση της Homo Digitalis, καθώς και τη δυνατότητα να αναπτύξουμε ένα μοναδικό δίκτυο επαφών με άλλες οργανώσεις της ΚτΠ και ειδικούς στο πεδίο.

!

Δημοσιεύουμε κοινή δήλωση για τις αναμενόμενες Κατευθυντήριες Γραμμές της Ευρωπαϊκής Επιτροπής για τις Απαγορευμένες Πρακτικές του AI Act

Στις 11 Δεκεμβρίου 2024, η Ευρωπαϊκή Επιτροπή ολοκλήρωσε τη δημόσια διαβούλευσή της για την ερμηνεία του ορισμού ενός συστήματος Τεχνητής Νοημοσύνης και για τις απαγορευμένες πρακτικές τεχνητής νοημοσύνης, σύμφωνα με τις διατάξεις του Κανονισμού 2024/1689 (AI Act). H Homo Digitalis είχε συμμετάσχει στη σχετική διαδικασία.

Στο πλαίσιο της έκδοσης των αναμενόμενων κατευθυντηρίων γραμμών της Επιτροπής, παραμένουν ανησυχίες για ενδεχόμενα κενά που θα μπορούσαν να θέσουν σε κίνδυνο τα θεμελιώδη δικαιώματα. Γι’ αυτόν τον λόγο και από κοινού με περισσότερες από 25 οργανώσεις της Κοινωνίας των Πολιτών, ακαδημαϊκούς και άλλους ειδικούς, εκδίδουμε σήμερα μία δήλωση ζητώντας από την Υπηρεσία Τεχνητής Νοημοσύνης (AI Office) και την Ευρωπαϊκή Επιτροπή να εξασφαλίσουν συγκεκριμένα αιτήματα.

Μπορείτε να διαβάσετε τη κοινή μας δήλωση εδώ.

!

O Λευτέρης Χελιουδάκης της Homo Digitalis Εκπαιδευτής σε 3η Εκπαίδευση του OSCE ODIHR για προσωπικά δεδομένα & προστασία συνόρων

Από τις 4 έως τις 6 Δεκεμβρίου, ο Λευτέρης Χελιουδάκης, συνιδρυτής και Εκτελεστικός μας Διευθυντής συμμετείχε ως εκπαιδευτής στην τρίτη Εκπαίδευση που διοργάνωσε ο διεθνής οργανισμός OSCE και συγκεκριμένα το Γραφείο του για τους Δημοκρατικούς Θεσμούς και τα Ανθρώπινα Δικαιώματα (OSCE Office for Democratic Institutions and Human Rights (ODIHR)) στη Βαρσοβία διερευνώντας τη χρήση νέων τεχνολογιών στα διεθνή σύνορα, καθώς και τους κινδύνους αλλά και τις ευκαιρίες που απορρέουν σχετικά με τα Δικαιώματα του Ανθρώπου.

Στις 4 παρουσιάσεις μας, εστιάσαμε στις τεχνολογίες που χρησιμοποιούνται στα σύνορα, τα Δικαιώματα του Ανθρώπου που επηρεάζονται από τις εν λόγω χρήσεις, τις διατάξεις του GDPR αλλά και της Οδηγίας 2016/680 LED, καθώς και τη σημαντική απόφαση της ΑΠΔΠΧ για τα συστήματα “ΚΕΝΤΑΥΡΟΣ” και “ΥΠΕΡΙΩΝ”.

Ευχαριστούμε θερμά τα άτομα που συμμετείχαν στην εκπαίδευση για τη δυναμική τους παρουσία, την ομάδα των εξαιρετικών υπολοίπων εκπαιδευτών Nikola Kovačević, Djordje Alempijevic και Arancha Garcia del Soto για τις γνώσεις και την εμπειρία τους και την ομάδα των διοργανωτών για την άψογη διοργάνωση και τη συμβολή τους, Lola Girard, Veronica Grazzi! Eίναι μεγάλη μας τιμή να συμμετέχουμε!

Μπορείτε να μάθετε περισσότερα εδώ.

Δημοσιεύουμε την Τρίτη Μελέτη μας για την AI Act εστιάζοντας στο Άρθρο 5 & τις Απαγορευμένες Πρακτικές

Σήμερα η Homo Digitalis δημοσιεύει την τρίτη μελέτη της για τον Κανονισμό 2024/1689, τη πασίγνωστη πλέον AI Act με τίτλο «Πράξη για την Τεχνητή Νοημοσύνη: Ανάλυση διατάξεων για τις απαγορευμένες πρακτικές του άρθρου 5 του Κανονισμού 2024/1689».

Η συγγραφική ομάδα της μελέτης αποτελείται από τη Σοφία Αντωνοπούλου, τη Λαμπρινή Γυφκτοκώστα, την Τάνια Σκραπαλιώρη, τον Λευτέρη Χελιουδάκη και τη Σταυρούλα Χούσου.

Σκοπός της παρούσας ανάλυσης της Homo Digitalis είναι η συστηματική προσέγγιση κάθε διάταξης του άρθρου 5 του Κανονισμού για την ΤΝ, που σχετίζονται με τις Χειριστικές ή παραπλανητικές τεχνικές, την Εκμετάλλευση τρωτών στοιχείων, την Αξιολόγηση κοινωνικής συμπεριφοράς, τις Βάσεις δεδομένων αναγνώρισης προσώπου, την Πρόβλεψη τέλεσης αξιόποινης πράξης, τη Συναγωγή συναισθημάτων, τα Συστήματα βιομετρικής κατηγοριοποίησης και την Εξ αποστάσεως βιομετρική ταυτοποίηση.

Με τη μελέτη μας παρέχουμε στοχευμένα ερωτήματα που αναδεικνύουν τις κρίσιμες πτυχές των επί μέρους διατάξεων, εντοπίζοντας τις λεγόμενες “γκρι ζώνες” – εκείνων των σημείων δηλαδή που παρουσιάζουν ασάφειες, επικαλύψεις ή δυνητικές ερμηνευτικές δυσκολίες, ενώ τεκμηριώνουμε τους προβληματισμούς μας μέσω συγκεκριμένων παραδειγμάτων. Τέλος, διατυπώνουμε συγκεκριμένα ερωτήματα προς επεξήγηση από τις επικείμενες κατευθυντήριες γραμμές της Υπηρεσίας για την ΤΝ της Ευρωπαϊκής Επιτροπής (ΑΙ Office) αλλά και τον εθνικό νομοθέτη, με στόχο την πληρέστερη αποσαφήνιση των υφιστάμενων ζητημάτων.

Όπως οι δύο πρώτες μας μελέτες (οι οποίες δημοσιεύθηκαν τον Οκτώβριο και τον Νοέμβριο του 2024, αντίστοιχα) και η τρίτη μας Μελέτη έχει ως σκοπό να σταθεί αρωγός στο Υπουργείο Ψηφιακής Διακυβέρνησης που έχει ως αποστολή να μεταφέρει την AI Act στην Ελλάδα, αλλά και με τις λεπτομερείς αναλύσεις και τα επιχειρήματά μας να βοηθήσουμε στην ωρίμανση του δημόσιου διαλόγου και να δώσουμε τη δυνατότητα σε περισσότερες οργανώσεις της Κοινωνίας των Πολιτών να συμμετέχουν ενεργά σε αυτόν.

Μπορείτε να διαβάσετε τη Μελέτη μας «Πράξη για την Τεχνητή Νοημοσύνη: Ανάλυση διατάξεων για τις απαγορευμένες πρακτικές του άρθρου 5 του Κανονισμού 2024/1689» εδώ.

Η Homo Digitalis συμμετείχε στη διαβούλευση του Γραφείου Τεχνητής Νοημοσύνης για τις Απαγορευμένες Πρακτικές στο πλαίσιο της AI Act.

Τον Νοέμβριο του 2024, το Γραφείο Τεχνητής Νοημοσύνης της Ευρωπαϊκής Επιτροπής ξεκίνησε διαβούλευση σχετικά με τις απαγορευμένες πρακτικές συστημάτων ΤΝ και τον ορισμό των συστημάτων Τεχνητής Νοημοσύνης που προβλέπουν οι διατάξεις του Κανονισμού για την Τεχνητή Νοημοσύνη.

Οι κατευθυντήριες γραμμές που βρίσκονται υπό επεξεργασία θα βοηθήσουν τις εθνικές αρμόδιες αρχές, καθώς και τους παρόχους, να συμμορφωθούν με τους κανόνες του Κανονισμού για την Τεχνητή Νοημοσύνη όσον αφορά αυτές τις πρακτικές, πριν από την εφαρμογή των σχετικών διατάξεων στις 2 Φεβρουαρίου 2025.

Η Homo Digitalis συμμετείχε σε αυτή τη δημόσια διαβούλευση υποβάλλοντας τις προτάσεις μας, με στόχο να αναδείξουμε προκλήσεις και να παρέχουμε περαιτέρω σαφήνεια σχετικά με πρακτικά ζητήματα και επιμέρους περιπτώσεις χρήσης.

Η ομάδα συγγραφής της δημόσιας διαβούλευσης αποτελείται από τη Διευθύντρια Ανθρωπίνων Δικαιωμάτων και Τεχνητής Νοημοσύνης μας, Λαμπρινή Γυφτοκώστα, και τα μέλη μας Σοφία Αντωνοπούλου και Σταυρίνα Χούσου.

Μπορείτε να διαβάσετε την παρέμβασή μας εδώ.

Μείνετε συντονισμένοι, καθώς σύντομα θα δημοσιεύσουμε την ειδική μας αναφορά σχετικά με τον Κανονισμό για την Τεχνητή Νοημοσύνη και τις διατάξεις του για τις Απαγορευμένες Πρακτικές!